AlexNet est un réseau neuronal convolutif profond (CNN) révolutionnaire proposé par Alex Krizhevsky, Ilya Sutskever et Geoffrey Hinton en 2012. Ce modèle a marqué un tournant décisif dans l’histoire de l’apprentissage profond et de la vision par ordinateur.

AlexNet a remporté la première place au concours ILSVRC 2012 avec une marge de 9,8 points de pourcentage sur son plus proche concurrent, obtenant des résultats révolutionnaires qui ont conduit à la renaissance de l’apprentissage profond dans le domaine de la reconnaissance d’images.

Publication et Reconnaissance Académique

Les résultats de cette recherche ont été publiés dans l’article « ImageNet Classification with Deep Convolutional Neural Networks » lors de la conférence NIPS 2012. Cette publication compte environ 28 000 citations et est considérée comme l’un des articles les plus influents en vision par ordinateur.

L’article est également disponible dans les Communications of the ACM, renforçant sa reconnaissance par la communauté scientifique internationale.

Architecture et Spécifications Techniques

Structure du Réseau

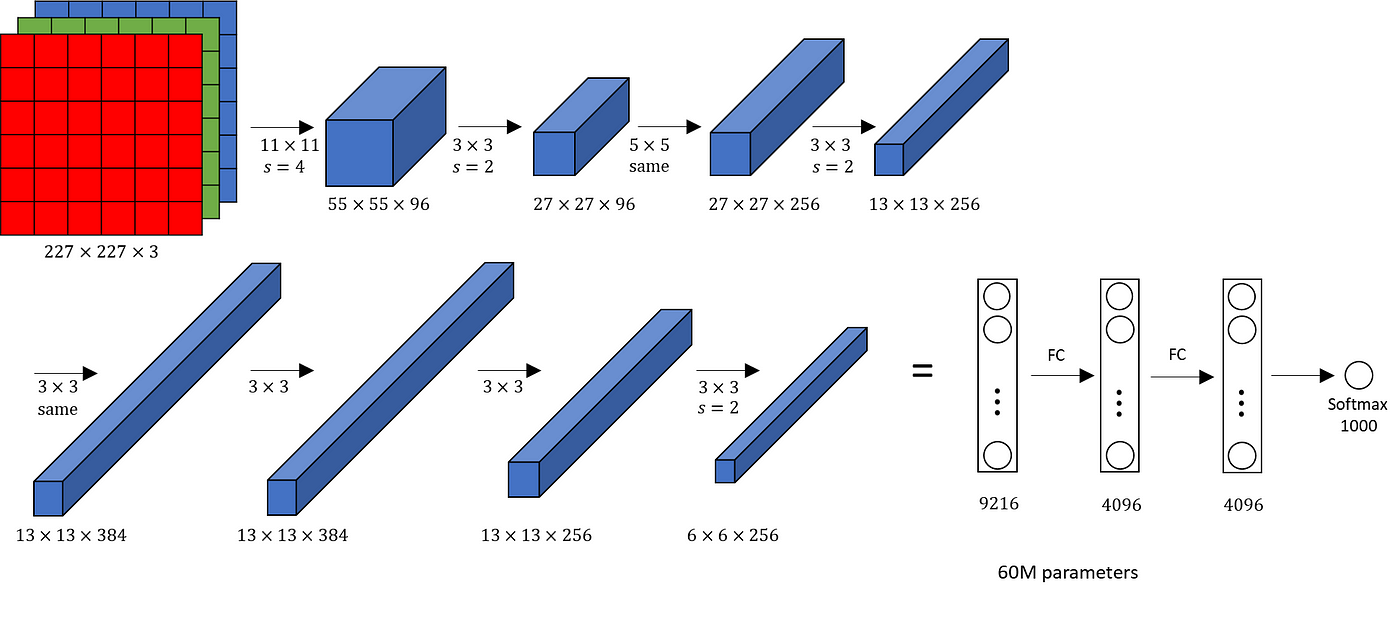

AlexNet possède une structure relativement profonde pour l’époque, composée de 8 couches au total :

- 5 couches convolutives (certaines suivies de couches de max-pooling)

- 3 couches entièrement connectées

- Une couche finale softmax à 1000 sorties pour la classification

Le réseau contient 60 millions de paramètres et 650 000 neurones, ce qui en faisait l’un des plus grands réseaux neuronaux convolutifs de l’époque.

Innovations Techniques Clés

1. Fonction d’activation ReLU

AlexNet utilise la fonction d’activation ReLU (Rectified Linear Unit) pour résoudre le problème de disparition du gradient inhérent aux fonctions d’activation sigmoïde et tanh traditionnelles. Cette innovation permet au réseau de converger beaucoup plus rapidement et d’améliorer les capacités d’expression non linéaire.

2. Utilisation des GPU

AlexNet s’est démarqué en utilisant des processeurs graphiques pour paralléliser les calculs, permettant ainsi d’entraîner un réseau particulièrement profond. Le réseau était divisé entre deux GPU NVIDIA GTX 580 de 3 GB chacune en raison des limitations mémoire de l’époque.

3. Techniques de Régularisation

- Dropout : Application d’un taux de dropout de 0,5 dans les deux premières couches entièrement connectées pour réduire le surapprentissage

- Augmentation de données : Transformation des images d’entraînement pour améliorer la généralisation

- Max-pooling avec chevauchement : Utilisation de fenêtres 3×3 avec un pas de 2, réduisant les taux d’erreur de 0,4% (top-1) et 0,3% (top-5)

Résultats et Performance

Compétition ILSVRC 2012

AlexNet a participé au challenge ImageNet 2012 sur un ensemble de données comprenant :

- 1,2 million d’images d’entraînement

- 50 000 images de validation

- 150 000 images de test

- 1 000 classes d’objets différentes

Performances Exceptionnelles

Sur les données de test, AlexNet a atteint des taux d’erreur top-1 et top-5 de 37,5% et 17,0% respectivement, des résultats considérablement meilleurs que l’état de l’art précédent.

En 2011, un bon taux d’erreur de classification ILSVRC était d’environ 25%. En 2012, AlexNet a atteint un taux d’erreur de 16%, marquant une amélioration spectaculaire qui a révolutionné le domaine.

Paramètres d’Entraînement

L’entraînement d’AlexNet s’est effectué avec les paramètres suivants :

- Taille de batch : 128

- Momentum : 0.9

- Décroissance des poids : 0.0005

- Taux d’apprentissage initial : 0.01 (réduit manuellement de 10 fois quand l’erreur de validation cessait de s’améliorer)

- Durée d’entraînement : Environ 90 epochs sur 5-6 jours avec deux NVIDIA GTX 580

Impact et Héritage

Révolution de l’Apprentissage Profond

Jusqu’à ce moment, l’apprentissage profond était une idée intéressante que la plupart considéraient comme impraticable. AlexNet a montré que l’apprentissage profond était plus qu’un rêve et les auteurs ont montré au monde comment le rendre pratique.

Influence sur les Architectures Futures

AlexNet a inspiré de nombreuses architectures CNN ultérieures. Microsoft Research Asia a détrôné AlexNet en tant que vainqueur d’ILSVRC en 2015 avec des réseaux encore plus profonds, mais les principes fondamentaux établis par AlexNet restent influents.

Contexte Historique

AlexNet n’était pas la première implémentation d’un réseau neuronal convolutif utilisant des processeurs graphiques. Des travaux similaires avaient été réalisés dès 2006 et 2011, mais AlexNet a réussi à synthétiser et populariser ces approches de manière décisive.

AlexNet représente donc un jalon fondamental dans l’histoire de l’intelligence artificielle et de la vision par ordinateur. En combinant une architecture profonde, des innovations techniques comme ReLU et l’utilisation optimisée des GPU, ce modèle a ouvert la voie à l’ère moderne de l’apprentissage profond. Son succès éclatant lors du challenge ImageNet 2012 a non seulement révolutionné la recherche en vision par ordinateur, mais a également inspiré une nouvelle génération d’architectures de réseaux neuronaux toujours plus performantes.